[ad_1]

లండన్ (AP) – ఆన్లైన్లో మనం ఎదుర్కొంటున్న అతిపెద్ద సమస్యల్లో AI నకిలీ ఒకటిగా మారుతోంది. ఉత్పాదక కృత్రిమ మేధస్సు సాధనాల పెరుగుదల మరియు దుర్వినియోగం మోసపూరిత ఫోటోలు, వీడియోలు మరియు ఆడియోల విస్తరణకు దారితీసింది.

టేలర్ స్విఫ్ట్ నుండి డోనాల్డ్ ట్రంప్ వరకు ప్రతి ఒక్కరినీ వర్ణించే AI డీప్ఫేక్లు దాదాపు ప్రతిరోజూ పాప్ అప్ అవుతున్నందున, ఏది వాస్తవమో మరియు ఏది కాదో చెప్పడం చాలా కష్టంగా మారుతోంది. DALL-E, Midjourney మరియు OpenAI యొక్క Sora వంటి వీడియో మరియు ఇమేజ్ జనరేటర్లు సాంకేతిక నైపుణ్యాలు లేని వ్యక్తులు డీప్ఫేక్లను సృష్టించడాన్ని సులభతరం చేస్తాయి. మీ అభ్యర్థనను టైప్ చేయండి మరియు సిస్టమ్ దాన్ని ఉమ్మివేస్తుంది.

ఈ నకిలీ చిత్రాలు ప్రమాదకరం అనిపించవచ్చు. అయితే, వాటిని మోసం, గుర్తింపు చౌర్యం, ప్రచారం మరియు ఎన్నికల తారుమారు కోసం ఉపయోగించవచ్చు.

డీప్ఫేక్ల ద్వారా మోసపోకుండా ఎలా ఉండాలో ఇక్కడ ఉంది.

డీప్ఫేక్ను ఎలా గుర్తించాలి

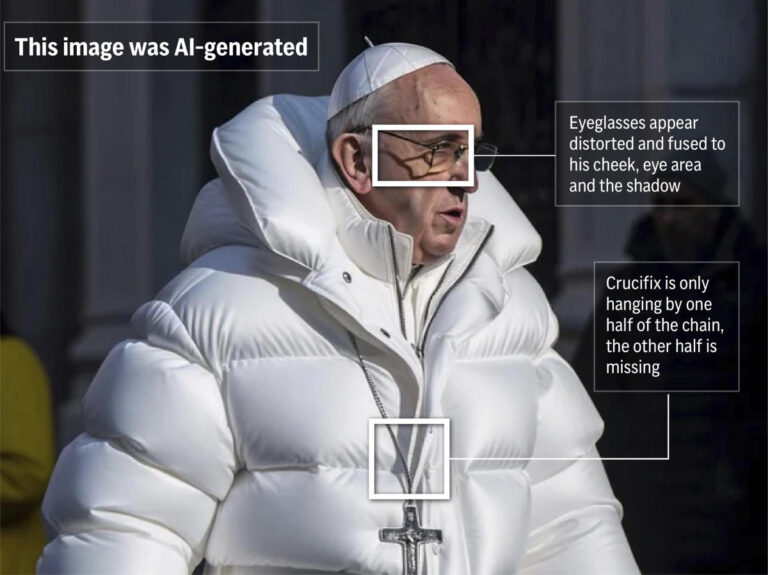

డీప్ఫేక్ల ప్రారంభ రోజులలో, సాంకేతికత పరిపూర్ణంగా లేదు మరియు తరచుగా తారుమారు యొక్క స్పష్టమైన సంకేతాలను వదిలివేస్తుంది. వాస్తవం తనిఖీ చేసేవారు స్పష్టమైన లోపాలతో ఉన్న చిత్రాలను ఎత్తి చూపారు, అంటే ఆరు వేళ్లు ఉన్న చేతి మరియు వివిధ ఆకృతుల లెన్స్లతో గాజులు వంటివి.

అయితే, AI అభివృద్ధి చెందుతున్న కొద్దీ, ఇది చాలా కష్టతరంగా మారింది. కన్సల్టింగ్ సంస్థ లాటెంట్ స్పేస్ అడ్వైజరీ వ్యవస్థాపకుడు మరియు ఉత్పాదక AIపై ప్రముఖ నిపుణుడు హెన్రీ అజ్డర్, డీప్ఫేక్ వీడియోలలో ప్రజల దృష్టిలో అసహజమైన బ్లింక్ నమూనాలను వెతకడం వంటి విస్తృతంగా పంచుకున్న కొన్ని సలహాలు ఇకపై పని చేయవని చెప్పారు. .

ఇంకా కొన్ని అంశాలు చూడాల్సి ఉందని చెప్పారు.

చాలా AI డీప్ఫేక్ ఫోటోలు, ముఖ్యంగా వ్యక్తులు, వాటికి ఎలక్ట్రానిక్ షీన్ను కలిగి ఉంటాయి, అది వాటికి “ఒక విధమైన సౌందర్య స్మూత్టింగ్ ఎఫెక్ట్” ఇస్తుంది మరియు చర్మాన్ని “నమ్మశక్యం కాని పాలిష్గా” చేస్తుంది అని అజ్దర్ చెప్పారు.

అయినప్పటికీ, సృజనాత్మక ప్రాంప్ట్లు వీటిని మరియు AI తారుమారుకి సంబంధించిన అనేక ఇతర సంకేతాలను తొలగించగలవని అతను హెచ్చరించాడు.

నీడలు మరియు లైటింగ్ యొక్క స్థిరత్వాన్ని తనిఖీ చేయండి. తరచుగా విషయం స్పష్టంగా దృష్టిలో ఉంటుంది మరియు వాస్తవంగా కనిపిస్తుంది, కానీ నేపథ్య అంశాలు వాస్తవికంగా లేదా అధునాతనంగా ఉండకపోవచ్చు.

నీ ముఖం చూడు

ఫేస్ స్వాపింగ్ అనేది అత్యంత సాధారణ డీప్ఫేక్ టెక్నిక్లలో ఒకటి. నిపుణులు మీ ముఖం అంచులను దగ్గరగా చూడాలని సలహా ఇస్తారు. ముఖం యొక్క స్కిన్ టోన్ మిగిలిన తల మరియు శరీరానికి సరిపోతుందా? ముఖం యొక్క అంచులు పదునుగా ఉన్నాయా లేదా అస్పష్టంగా ఉన్నాయా?

మాట్లాడే వ్యక్తి వీడియో డాక్టరేడ్ అని మీరు అనుమానించినట్లయితే, వారి నోటిని చూడండి. వారి పెదవుల కదలికలు వారి మాటలకు సరిగ్గా సరిపోతాయా?

అజ్డెర్ దంతాలను చూడాలని సూచించాడు. అవి స్పష్టంగా ఉన్నాయా లేదా అస్పష్టంగా ఉన్నాయా మరియు వాస్తవానికి అవి కనిపించే దానికి సరిపోలడం లేదా?

సైబర్ సెక్యూరిటీ సంస్థ నార్టన్ ప్రకారం, వ్యక్తిగత దంతాల రూపురేఖలు లేకపోవడం ఒక క్లూ కావచ్చు, ఎందుకంటే అల్గారిథమ్లు వ్యక్తిగత దంతాలను రూపొందించేంత అధునాతనమైనవి కాకపోవచ్చు.

పెద్ద చిత్రం గురించి ఆలోచించండి

కొన్నిసార్లు సందర్భం ముఖ్యమైనది. మీరు చూస్తున్నది నమ్మదగినదేనా అని ఒక్కసారి ఆలోచించండి.

“అతిశయోక్తి, అవాస్తవికం లేదా నమ్మశక్యంకాని” ఏదైనా ఒక పబ్లిక్ ఫిగర్ చేయడం మీరు చూస్తుంటే, అది డీప్ఫేక్ అని Poynter జర్నలిజం వెబ్సైట్ సలహా ఇస్తుంది.

ఉదాహరణకు, అప్రసిద్ధ నకిలీ ఫోటోలో చిత్రీకరించిన విధంగా పోప్ నిజంగా హై-ఎండ్ డౌన్ జాకెట్ని ధరించారా? అలా అయితే, చట్టబద్ధమైన మూలాల ద్వారా అదనపు ఫోటోలు మరియు వీడియోలను విడుదల చేయవచ్చా?

నకిలీలను కనుగొనడానికి AIని ఉపయోగించండి

AIతో పోరాడేందుకు AIని ఉపయోగించడం మరొక విధానం.

మైక్రోసాఫ్ట్ ఫోటోలు మరియు వీడియోలను విశ్లేషించి, అవి మానిప్యులేట్ చేయబడిందా లేదా అనే దానిపై మీకు కాన్ఫిడెన్స్ స్కోర్ను అందించగల ప్రామాణీకరణ సాధనాన్ని అభివృద్ధి చేసింది. చిప్మేకర్ ఇంటెల్ యొక్క ఫేక్క్యాచర్ చిత్రం నిజమైనదా లేదా నకిలీదా అని నిర్ణయించడానికి చిత్రంలో పిక్సెల్లను విశ్లేషించడానికి ఒక అల్గారిథమ్ను ఉపయోగిస్తుంది.

మీరు ఫైల్లను అప్లోడ్ చేసినప్పుడు లేదా సందేహాస్పదమైన మెటీరియల్కి లింక్లను అతికించినప్పుడు నకిలీలను పసిగట్టడానికి ఆన్లైన్ సాధనాలు ఉన్నాయి. అయినప్పటికీ, Microsoft యొక్క ప్రామాణీకరణ వ్యవస్థ వంటి కొన్ని ప్రమాణీకరణ వ్యవస్థలు ఎంపిక చేసుకున్న భాగస్వాములకు మాత్రమే అందుబాటులో ఉంటాయి మరియు ప్రజలకు అందుబాటులో ఉండవు. పరిశోధకులు చెడ్డ వ్యక్తులను గుర్తించి డీప్ఫేక్ ఆయుధాల రేసులో మెరుగైన స్థానాన్ని పొందాలని కోరుకోరు.

డిటెక్షన్ టూల్స్కు ఓపెన్ యాక్సెస్ అనేది డిటెక్షన్ టూల్స్ “దేవుని లాంటి సాంకేతికతలు, వీటికి క్లిష్ట ఆలోచనలను అవుట్సోర్స్ చేయవచ్చు” అనే అభిప్రాయాన్ని కూడా ప్రజలకు కలిగిస్తుంది, వారు తమ పరిమితుల గురించి తెలుసుకోవాలి అని అజ్డెల్ చెప్పారు.

నకిలీలను కనుగొనడానికి అడ్డంకులు

కృత్రిమ మేధస్సు విపరీతమైన వేగంతో పురోగమిస్తోంది మరియు తక్కువ లోపాలతో అధిక-నాణ్యత కంటెంట్ను ఉత్పత్తి చేయడానికి AI మోడల్లు ఇంటర్నెట్ డేటాపై శిక్షణ పొందుతున్నాయి.

అంటే, ఈ సలహా ఏడాది తర్వాత కూడా చెల్లుబాటు అవుతుందన్న గ్యారెంటీ లేదు.

సాధారణ ప్రజలపై డిజిటల్ షెర్లాక్గా మారే భారాన్ని మోపడం కూడా ప్రమాదకరమని నిపుణులు అంటున్నారు. ఎందుకంటే శిక్షణ పొందిన కంటికి కూడా డీప్ఫేక్లను గుర్తించడం చాలా కష్టంగా మారుతున్నందున ఇది ప్రజలకు తప్పుడు విశ్వాసాన్ని ఇస్తుంది.

___

స్వెన్సన్ న్యూయార్క్ నుండి నివేదించారు.

___

అసోసియేటెడ్ ప్రెస్ ఎన్నికలు మరియు ప్రజాస్వామ్యం గురించి మా వివరణాత్మక కవరేజీని మెరుగుపరచడానికి అనేక ప్రైవేట్ ఫౌండేషన్ల నుండి మద్దతు పొందుతుంది. AP డెమోక్రసీ ఇనిషియేటివ్ గురించి మరింత తెలుసుకోండి. మొత్తం కంటెంట్కు AP పూర్తిగా బాధ్యత వహిస్తుంది.

[ad_2]

Source link